أظهرها في حالة سُكر خلال حديث بلقاء عام

فيديو «تزييف عميق» لنانسي بيلوسي يثير جدلاً واسعاً

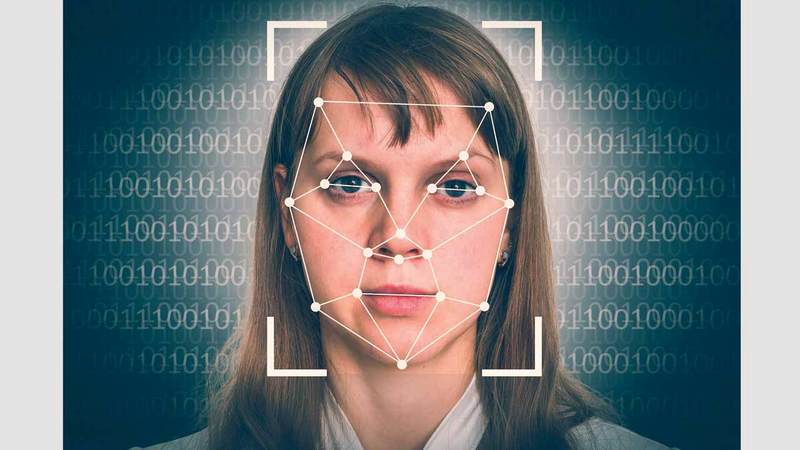

الفيديوهات عميقة التزييف تعتمد على الذكاء الاصطناعي وتعلم الآلة. من المصدر

بعد الرئيس الأميركي السابق، باراك أوباما، وممثلة تلفزيون الواقع، كيم كاردشيان، والرئيس التنفيذي لشركة «فيس بوك»، مارك زوكربيرغ، وغيرهم من المشاهير والقادة، وقعت رئيس مجلس النواب الأميركي، نانسي بيلوسي، أخيراً، ضحية لمحترفي فيديوهات «التزييف العميق»، حيث ظهرت في فيديو وهي في حالة سكر، وارتباك وتلعثم في كلماتها، أثناء حديثها في لقاء عام. وكان الفيديو غاية في الإتقان، فانتشر على نطاق واسع خلال وقت قصير على أنه حقيقة، محدثاً جدلاً واسعاً، ليس تجاه ظاهرة «التزييف العميق» فحسب، وإنما الأهم تجاه شبكات التواصل الاجتماعي وموقفها من تلك الظاهرة، بعد أن أظهرت هذه الشبكات تراخياً وتباطؤاً واضحاً في التعامل مع الأمر، إذ إن «تويتر» ترك الفيديو بلا حذف، و«فيس بوك» وضع قيوداً مخففة على مشاهدته، و«يوتيوب» حذفه، لكن بعد فترة طويلة من الوقت.

مصدر قلق

وتباينت الآراء وردود الفعل حول موقف الشبكات الثلاث من تلك القضية، وما إذا كان هذا الموقف ناجماً عن أنها ليست جاهزة تقنياً وفنياً لاكتشاف واعتراض وإيقاف الفيديوهات المزيفة بعمق، أم أن ردود فعلها ناجمة عن موقف مسبق، لا علاقة له بالمقدرة التقنية. ونظراً إلى أن الأمر لم يحسم على أي نحو، باتت القضية مصدر قلق، إذ إن آخر تقرير صادر عن وكالة الأمن القومي الأميركية أضافها إلى قائمة أكبر التهديدات الأمنية العالمية لعام 2019، وذلك بحسب ما نشرته على موقعها www.dni.govفي هذا الشأن، فيما باتت هناك حالة من الترقب والحذر لما يمكن أن تفعله تلك الظاهرة من تأثيرات سلبية في بعض الأحداث المهمة، وفي مقدمتها انتخابات الرئاسة الأميركية المقررة العام المقبل، وهو الأمر الذي جعل باحثين في جامعة «كاليفورنيا ببيركلي» يصدرون ورقة بحثية حول «كيفية حماية قادة العالم من التزييف العميق».

التزييف العميق

وتعرف الفيديوهات عميقة التزييف بأنها سلالة جديدة من مقاطع الفيديو المزيفة، التي يتم فيها استبدال وجه وصوت شخص ما بصوت ووجه شخص آخر، وذلك باستخدام التقنيات المتقدمة، مثل خوارزميات الذكاء الاصطناعي وتعلم الآلة والشبكات العصبية، في التعرف إلى الجوانب الصوتية أو البصرية الفعلية لشخص ما، وتصوير فيديو له وهو يقول ما يحلو له، ثم استخدام ذات الخوارزميات والتقنيات في التعرف إلى الجوانب الصوتية أو البصرية الفعلية لشخص آخر وهو يتحدث بطريقة فعلية وحقيقية في فيديو آخر، ومطلوب تزييف فيديو له، وبعد ذلك يتم استبدال ما قاله الشخص الثاني الحقيقي، بما قاله الشخص الأول المزيف، لينطق الشخص الحقيقي ما قاله ونطق به الشخص المزيف، وبتعبيرات وتلميحات الوجه نفسها التي كانت لدى الشخص المزيف ومستويات صوته، ونبراته وحركاته، وذلك بطريقة كاملة التطابق، بما يجعل التزييف عميقاً إلى الدرجة التي تجعل من الصعوبة الشديدة معرفة أن الفيديو ليس حقيقياً.

وحتي وقت قريب، كان يعتقد أن عدداً محدوداً من المختبرات العالمية هو من يملك هذه التقنية، والبعض منها موجود في استديوهات السينما والألعاب لأغراض إنتاج الأفلام والخدع السينمائية وأفلام الخيال العلمي وغيرها، لكن التطورات الأخيرة أثبتت أن أدوات التزييف العميق باتت متاحة عبر الإنترنت على نطاق أوسع مما يعتقد، والبعض منها لديه القدرة على إنتاج فيديو كامل لدقائق عدة من صورة واحدة فقط للشخص المطلوب تزييف فيديو له، حتى إن شركة «سامسونغ» تحدثت عن أداة من هذا النوع، ونشرت فيديو توضيحياً، تظهر فيه صورة واحدة للموناليزا، المرأة التي تظهر في اللوحة الشهيرة، وهي تتحدث وكأنها منخرطة في حوار أو تلقي خطاب في لقاء عام.

ردود فعل

الجانب الأكثر جدلاً في هذا الأمر حالياً هو ردود الفعل من جانب شبكات التواصل الاجتماعي، التي يتهمها الجميع بالتراخي والتباطؤ في التعامل مع هذه الفيديوهات حال ظهورها واكتشافها، ففي حالة فيديو نانسي بيلوسي ظهر الفيديو للمرة الأولى على صفحة «فيس بوك» بعنوان «بوليتيكس ووتش دوج»، وسمح «فيس بوك» للفيديو بالبقاء على خدمته، لكنه وضع قيوداً للوصول إليه.

أما «تويتر» فكان أكثر تباطؤاً وتراخياً، حيث ترك الفيديو قائماً كما هو على منصته، حتى إن ردود الأفعال من جانب شبكات التواصل دفعت لجنة الاستخبارات بمجلس النواب لعقد جلسة استماع في 20 يونيو الجاري لمناقشة الأمر.

كشف التزييف العميق

يعمل بعض الباحثين على إيجاد طرق لمكافحة الفيديوهات عميقة التزييف، ومنهم مدير قسم الرؤية بالحاسب وتعلم الآلة في معامل جامعة الباني، الدكتور سيويل ليو، الذي نشر بحثاً علمياً في يونيو الماضي، أوضح فيه أن تتبع وميض العين والطرف، أو حركة الجفن وهو يطرف، تعد من العلامات المهمة التي يمكن من خلالها كشف التزييف العميق في الفيديوهات المشكوك فيها، مؤكداً أن الوميض والطرف معاً إذا لم يحدثا بطريقة معينة وفق النمط المعتاد حدوثه مع الشخص يكون الفيديو مشبوهاً ومشكوكاً فيه.

كما أكد أنه يبحث مع فريقه في بعض الأساليب الأخرى لكشف التزييف، لكنه فضل أن تظل سرية.